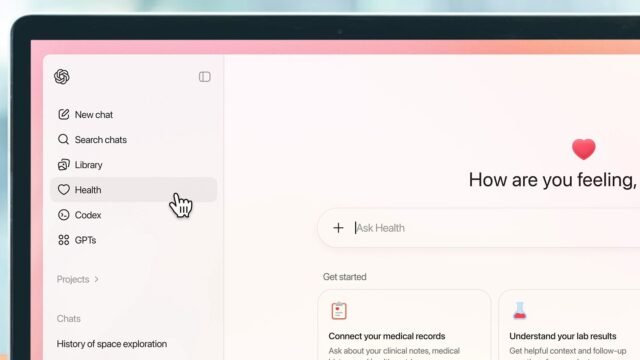

A OpenAI prometeu novas maneiras de potencializar a saúde com IA quando lançou o ChatGPT Health este mês. O recurso mais recente do chatbot de IA concentra-se na saúde em uma clínica virtual dedicada que pode processar dados de registros médicos eletrônicos (EMR) e aplicativos de condicionamento físico e saúde para fornecer respostas personalizadas sobre resultados de laboratório, dieta, exercícios e preparação para consultas médicas.

Com mais de 230 milhões de pessoas fazendo perguntas sobre saúde e bem-estar todas as semanas, o ChatGPT Health era inevitável. Mas apesar da OpenAI exagerar no valor do ChatGPT Health e suas garantias adicionais de segurança e privacidade, não irei me inscrever tão cedo.

desconfiança saudável

Apesar de todos os avisos sobre o que o ChatGPT Health pode ou não fazer por você, você pode ver por que ele pode seduzir as pessoas. Os sistemas de saúde podem ser complexos, muitas vezes sobrecarregados e financeiramente onerosos. ChatGPT Health fornece explicações mais claras do jargão médico, destaca coisas que vale a pena discutir com seu médico ou enfermeiro antes da consulta e permite analisar instantaneamente resultados de testes confusos.

ChatGPT Health é atraente por sua capacidade de fornecer insights que antes só estavam disponíveis em canais especializados. É fácil de vender, especialmente se você não tiver acesso fácil a cuidados de saúde regulares. Mas informações médicas pessoais valiosas e o histórico de alucinações da IA contribuem para uma cerveja pouco saudável.

Respostas enganosas ou fictícias já são ruins o suficiente, mesmo sem a necessidade de nuances médicas. Não me oponho a fazer perguntas ao ChatGPT sobre minha saúde ou condicionamento físico, mas isso está longe do que o ChatGPT Health sugere compartilhar.

“Explorar questões de saúde individuais é fundamentalmente diferente de fornecer uma plataforma com acesso a todo o seu histórico médico e histórico de saúde ao longo da vida”, explicou Alexander Tsiaras, fundador e CEO da plataforma de dados médicos StoryMD. “A confiança será um desafio fundamental não só para os indivíduos, mas para o sistema de saúde como um todo. Esta confiança dependerá da transparência: como os dados são recolhidos, como as alucinações são evitadas, como as provas clínicas longitudinais são integradas ao longo do tempo, e se a plataforma funciona dentro dos quadros regulamentares estabelecidos, incluindo a HIPAA”.

OpenAI não é um provedor de saúde. Não estamos sujeitos à Lei de Portabilidade e Responsabilidade de Seguros de Saúde (HIPAA) e às suas rigorosas obrigações e proteções legais para suas informações médicas. Portanto, embora a OpenAI possa prometer sinceramente tratar quaisquer dados de saúde que você carregue gratuitamente ou vincule ao ChatGPT Health com cuidado e segurança apropriados, não está claro se ela tem um incentivo legal para fazê-lo.

E se seus dados estiverem fora do escopo da HIPAA, você deverá confiar nas políticas e intenções da própria empresa, em vez de confiar nos padrões aplicáveis da HIPAA. Alguns podem argumentar que os próprios compromissos de privacidade da OpenAI são suficientes (por exemplo, os advogados da OpenAI).

gerenciamento de dados de saúde

A maioria das pessoas concorda que as informações médicas íntimas devem ser guardadas com as mais rigorosas proteções legais possíveis. No entanto, os usuários do ChatGPT Health ficam em uma posição precária, especialmente porque a linguagem da política e os termos de serviço podem mudar sem aviso prévio e com recursos limitados.

É uma boa ideia que o ChatGPT Health separe as conversas relacionadas à saúde e permita que os usuários excluam seus dados, mas uma vez que os dados saem do sistema de saúde tradicional, existem vulnerabilidades completamente diferentes a serem consideradas. Com muita frequência, as manchetes destacam como é difícil para as principais plataformas tecnológicas garantir a proteção completa dos dados contra vazamentos e hacks.

E existem riscos maiores para os seus dados, mesmo vindos de instituições legítimas. Os dados pessoais de saúde podem estar sujeitos a intimações, investigações judiciais ou outras formas de divulgação obrigatória. Em alguns casos, a Empresa poderá precisar entregar registros pessoais para cumprir uma ordem judicial ou solicitação governamental. A HIPAA tem uma defesa muito mais forte contra essa pressão legal do que as leis padrão de privacidade de tecnologia do consumidor sob as quais o ChatGPT opera.

Cuidados de saúde acessíveis e acessíveis são uma causa que vale a pena perseguir. Mas a privacidade, a confiança e a supervisão humana significativa não podem ser comprometidas nessa busca. As pessoas já estão preocupadas com a forma como as plataformas de IA recolhem e utilizam os seus dados. Centralizar informações mais sensíveis através de uma única entidade comercial não diminui estas preocupações.

Precisamos de uma conversa mais ampla sobre a integração da IA em sistemas dos quais os humanos dependem. A IA pode ser de grande ajuda na prestação de serviços de saúde. No entanto, isso não pressupõe que os seus dados pessoais serão entregues a condições de segurança e proteção incertas.

“Estas são necessidades básicas”, disse Tsiaras. “O que as pessoas realmente precisam são registros de saúde longitudinais e clinicamente sólidos que apoiem interações significativas entre pacientes e profissionais de saúde, e não outra camada de ruído.”

Siga o TechRadar no Google Notícias e Adicione-nos como fonte preferencial Receba notícias, análises e opiniões de especialistas em seu feed. Certifique-se de clicar no botão seguir!

Claro que você também pode Siga o TechRadar no TikTok Confira novidades, análises, unboxings em formato de vídeo e receba atualizações regulares. WhatsApp fazer.

Os melhores laptops empresariais para cada orçamento