A ruptura da Anthropic com Washington revelou a completa falta de regras coerentes que regem a inteligência artificial, mas uma coligação bipartidária de pensadores reuniu algo que o governo até agora se recusou a produzir: um quadro para como deveria ser realmente o desenvolvimento responsável da IA.

que declaração pró-humana Embora tenha sido concluído antes do impasse Pentágono-Humano da semana passada, o confronto entre os dois eventos não passou despercebido a ninguém envolvido.

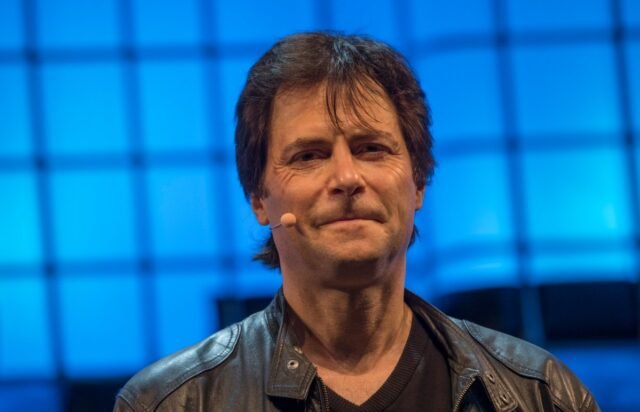

“Algo muito surpreendente aconteceu nos Estados Unidos nos últimos quatro meses”, disse Max Tegmark, físico do MIT e pesquisador de IA que ajudou a organizar o esforço. em conversa Com este editor. “De repente, as pesquisas mostraram que 95% de todos os americanos se opunham à competição não regulamentada de superinteligência.”

O documento recentemente divulgado, assinado por centenas de especialistas, antigos funcionários governamentais e figuras públicas, começa com a observação prática de que a humanidade se encontra numa encruzilhada. Um caminho, que o Manifesto chama de “competição pela substituição”, resulta na deslocação dos seres humanos, primeiro como trabalhadores e depois como decisores, à medida que o poder se acumula em instituições e máquinas irresponsáveis. A outra leva à IA, que expande enormemente o potencial humano.

O último cenário baseia-se em cinco princípios fundamentais: manter a responsabilidade humana, prevenir a concentração de poder, proteger a experiência humana, preservar a liberdade individual e responsabilizar legalmente as empresas de IA. Entre as disposições mais rigorosas está uma proibição total do desenvolvimento da superinteligência até que haja um consenso científico de que é segura e capaz de uma aprovação verdadeiramente democrática. Um interruptor indispensável para sistemas poderosos; Proíbe arquiteturas capazes de auto-replicação, auto-aperfeiçoamento autônomo ou resistência ao encerramento.

A divulgação da Declaração coincide com um período em que a sua urgência é muito mais facilmente reconhecida. Na última sexta-feira de fevereiro, o secretário de Defesa Pete Hegseth designou a Anthropic, cuja IA já funciona em plataformas militares classificadas, como um “risco da cadeia de abastecimento”. É um rótulo normalmente dado a empresas com ligações com a China, depois que a empresa se recusou a conceder ao Departamento de Defesa o uso irrestrito de sua tecnologia. Horas depois, a OpenAI assinou seu próprio contrato com o Departamento de Defesa, que, segundo especialistas jurídicos, será difícil de aplicar de forma significativa. O que tudo isto revela é quão dispendiosa tem sido a inacção do Congresso em relação à IA.

Dean Ball, membro sênior da Foundation for American Innovation, disse: disse ao New York Times “Esta não é apenas uma disputa sobre um contrato. Esta é a primeira conversa que tivemos como país sobre a governação dos sistemas de IA”, disse ele.

Evento de crise tecnológica

São Francisco, Califórnia

|

13 a 15 de outubro de 2026

Tegmark chegou a uma analogia que a maioria das pessoas consegue entender quando falamos sobre isso. “Não precisamos nos preocupar com a possibilidade de alguma empresa farmacêutica lançar outro medicamento que causa enormes danos antes que as pessoas descubram como torná-lo seguro, porque a FDA não permitirá que nenhum medicamento seja liberado até que seja suficientemente seguro”.

As lutas pelo poder em Washington geram pouca pressão pública para alterar a lei. Em vez disso, a Tegmark vê a segurança infantil como o ponto de pressão com maior probabilidade de resolver o impasse atual. Na verdade, a declaração apela à obrigatoriedade de testes pré-implantação de produtos de IA, especialmente chatbots e aplicações complementares destinadas a utilizadores mais jovens, que abordam riscos como o aumento de pensamentos suicidas, o agravamento das condições de saúde mental e a manipulação emocional.

“Se algum velho assustador enviar mensagens de texto para uma criança de 11 anos fingindo ser uma menina e convencer o menino a cometer suicídio, esse menino poderá ir para a cadeia”, disse Tegmark. “Já temos a lei. É ilegal. Então, por que seria diferente se uma máquina fizesse isso?”

Ele acredita que, uma vez estabelecidos os princípios de testes pré-lançamento para produtos infantis, o seu âmbito irá quase inevitavelmente expandir-se. “As pessoas virão e dirão: vamos adicionar alguns outros requisitos. Talvez precisemos testar para ver se isso não pode ajudar os terroristas a criar armas biológicas. Talvez precisemos testar para ter certeza de que a superinteligência não tem a capacidade de derrubar o governo dos EUA.”

Não é pouca coisa que o ex-assessor de Trump, Steve Bannon, e a conselheira de segurança nacional do presidente Obama, Susan Rice, tenham assinado o mesmo documento. O mesmo se aplica ao ex-presidente do Estado-Maior Conjunto, Mike Mullen, e aos líderes religiosos progressistas.

“É claro que eles concordam que são todos humanos”, diz Tegmark. “Se decidirmos se queremos um futuro humano ou um futuro mecânico, é claro que eles estarão do mesmo lado.”