O Google publicou uma postagem em um blog de pesquisa na terça-feira sobre um novo algoritmo de compressão para modelos de IA. Em poucas horas, os estoques de memória caíram. A Micron caiu 3%, a Western Digital caiu 4,7% e a SanDisk caiu 5,7% enquanto os investidores recalculavam quanta memória física a indústria de IA realmente precisa.

O algoritmo é chamado TurboQuant e resolve um dos gargalos mais caros ao executar grandes modelos de linguagem: o cache de valor-chave, um armazenamento de dados rápido que contém informações de contexto para que não precisem ser recalculadas a cada novo token gerado pelo modelo. À medida que os modelos processam entradas mais longas, o cache cresce rapidamente, consumindo memória da GPU que poderia ser usada para atender mais usuários ou executar modelos maiores. O TurboQuant compacta o cache dos 16 bits padrão para 3 bits por valor, reduzindo o uso de memória em pelo menos 6x sem qualquer perda mensurável de precisão, de acordo com os benchmarks do Google.

O artigo, a ser apresentado no ICLR 2026, foi de autoria de Amir Zandieh, cientista pesquisador do Google, e Vahab Mirrokni, vice-presidente e Google Fellow, com colaboradores do Google DeepMind, KAIST e Universidade de Nova York. Baseia-se em dois artigos anteriores do mesmo grupo: QJL, apresentado na AAAI 2025, e PolarQuant, que será apresentado na AISTATS 2026.

Como funciona

A principal inovação do TurboQuant é eliminar a sobrecarga que torna a maioria das técnicas de compressão menos eficazes do que os números das manchetes sugerem. Os métodos de quantização existentes reduzem o tamanho do vetor de dados, mas exigem o armazenamento de constantes adicionais, valores de normalização, exigidos pelo sistema para descompactar os dados com precisão. Essas constantes são descompactadas parcialmente, normalmente adicionando um ou dois bits extras por número.

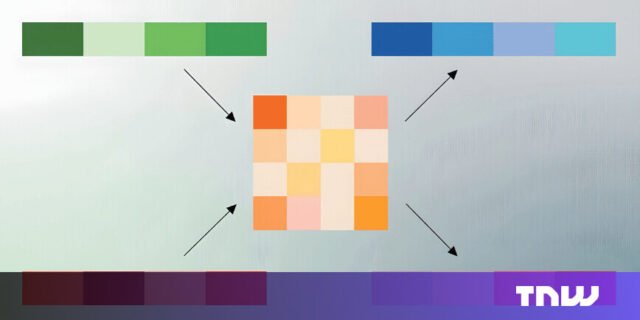

O TurboQuant evita isso com um processo de duas etapas. A primeira etapa, chamada PolarQuant, converte os vetores de dados em coordenadas cartesianas padrão em coordenadas polares, separando cada vetor em um conjunto de magnitudes e ângulos. Como a distribuição angular segue um padrão previsível e concentrado, o sistema pode pular completamente a dispendiosa etapa de normalização bloco a bloco. No segundo estágio, aplicamos QJL, técnica baseada na transformada de Johnson-Lindenstrauss, para reduzir os pequenos erros residuais do primeiro estágio a um único bit de sinal por dimensão. O resultado combinado é uma representação que utiliza a maior parte do orçamento de compressão para capturar o significado dos dados originais, sem a sobrecarga desperdiçada em constantes de regularização, e utiliza o orçamento restante mínimo para correção de erros.

O Google testou o TurboQuant em cinco benchmarks padrão para modelos de linguagem de contexto longo, incluindo LongBench, Needle in a Haystack e ZeroSCROLLS, usando modelos de código aberto das famílias Gemma, Mistral e Llama. Em 3 bits, o TurboQuant corresponde ou supera o KIVI, o padrão atual para quantização de cache de valor-chave apresentado no ICML 2024. Em uma tarefa de pesquisa em palheiro que testa se um modelo pode encontrar uma única informação enterrada em uma longa passagem, o TurboQuant alcançou uma pontuação perfeita ao compactar o cache por um fator de 6. Com precisão de 4 bits, este algoritmo melhora a velocidade de atenção computacional em até 8x em uma GPU Nvidia H100 em comparação com uma GPU Nvidia H100 em comparação com uma GPU Nvidia H100. linha de base descompactada de 32 bits.

O que o mercado ouviu

A reação das ações foi rápida e, na opinião de vários analistas, desproporcional. O analista do Wells Fargo, Andrew Rocha, apontou que o TurboQuant ataca diretamente a curva de custo de memória dos sistemas de IA. Se for amplamente adotado, disse ele, levantaria questões sobre quanta capacidade de memória a indústria realmente precisa. Mas Rocha e outros alertaram que a procura por memória de IA continua forte e que algoritmos de compressão existem há anos sem alterar fundamentalmente os volumes de aquisição.

No entanto, estas preocupações não são infundadas. Os gastos com infraestrutura de IA estão crescendo a um ritmo tremendo. A Meta comprometeu-se recentemente até 27 mil milhões de dólares em capacidade de computação dedicada num acordo com a Nebius, e a Google, a Microsoft e a Amazon estão a planear conjuntamente centenas de milhares de milhões de dólares em gastos de capital em centros de dados até 2026. As tecnologias que reduzem os requisitos de memória por um factor de 6 não reduzem os gastos por um factor de 6 porque a memória é apenas um componente dos custos do centro de dados. Mas isto altera os rácios e, a esta escala de gastos da indústria, mesmo as eficiências marginais aumentam rapidamente.

questões de eficiência

O TurboQuant chega em um momento em que a indústria de IA enfrenta a economia da inferência. Existe um custo único para treinar um modelo, mas o custo é proibitivo. Executá-los e processar milhões de consultas por dia com latência e precisão aceitáveis é um custo recorrente que determina se um produto de IA é financeiramente viável em escala. O cache de valores-chave é a chave para esse cálculo. É um gargalo que limita o número de usuários simultâneos que uma única GPU pode atender e a duração da janela de contexto que o modelo pode realmente suportar.

Tecnologias de compressão como o TurboQuant, juntamente com melhorias de hardware como a arquitetura Vera Rubin da Nvidia e o Ironwood TPU do Google, fazem parte de um esforço mais amplo para tornar a inferência mais acessível. A questão é se estes ganhos de eficiência reduzirão a quantidade global de hardware adquirido pela indústria ou se permitirão implementações mais ambiciosas com aproximadamente o mesmo custo. A história da computação sugere o último. À medida que o armazenamento se torna mais barato, as pessoas poupam mais. À medida que a largura de banda aumenta, seu aplicativo a consome.

Para o Google, o TurboQuant também possui aplicações comerciais diretas que vão além dos modelos de linguagem. A postagem do blog observa que esse algoritmo melhora a pesquisa vetorial, uma tecnologia que suporta pesquisas de similaridade semântica em bilhões de itens. Nós o testamos em relação aos métodos existentes no conjunto de dados de benchmark GloVe e descobrimos que ele obteve excelente recall sem o grande livro de códigos ou ajuste específico do conjunto de dados exigido pelas abordagens concorrentes. Isso é importante porque o Vector Search impulsiona a receita do Google: tudo, desde a Pesquisa Google até recomendações do YouTube e segmentação de anúncios.

A contribuição deste artigo é prática. Em outras palavras, é um método de compressão sem treinamento que alcança resultados significativamente melhores do que as técnicas de última geração existentes, com uma forte base teórica e implementação prática em hardware de produção. Se irá remodelar a economia da infra-estrutura de IA ou simplesmente tornar-se mais uma optimização absorvida pelo interminável apetite computacional da indústria é uma questão que o mercado responderá ao longo de meses, não de horas.