Os resultados de pesquisa gerados pela IA do Google estão lançando dezenas de milhões de respostas imprecisas por hora – assim como a gigante da tecnologia desvia receitas dos meios de comunicação, de acordo com uma análise bombástica.

Para testar a precisão das visões gerais de IA do Google, a startup Oumi revisou 4.326 resultados de pesquisa do Google gerados pelo modelo Gemini 2 do Google e o mesmo número de resultados gerados por seus modelos Gemini 3 mais avançados.

A análise descobriu que os modelos foram precisos em 85% e 91% das vezes, respectivamente.

Com a expectativa de que o Google lide com mais de 5 trilhões de pesquisas somente até 2026, isso significa que as visões gerais da IA estão divulgando notícias falsas em centenas de milhares de erros a cada minuto – sem que os usuários fiquem sabendo.

O New York Times foi o primeiro consulte a análise de Oumi.

“As visões gerais da IA do Google têm sido um desastre para os editores que dependem de cliques para produzir jornalismo de qualidade, mas também decepcionaram os usuários que procuram informações precisas”, disse Danielle Coffey, presidente e CEO da News/Media Alliance, um grupo comercial que representa mais de 2.000 meios de comunicação, incluindo o Post.

As respostas incorretas incluíram vários erros importantes, como enganar o ano em que o músico Bob Marley foi transformado em museu, deturpar o ano em que o ex-arremessador substituto da MLB Dick Drago morreu e afirmar que não há registro de Yo-Yo Ma sendo introduzido no Hall da Fama da Música Clássica, embora tenha sido em 2007, como exemplos fornecidos pelo Oumi Times.

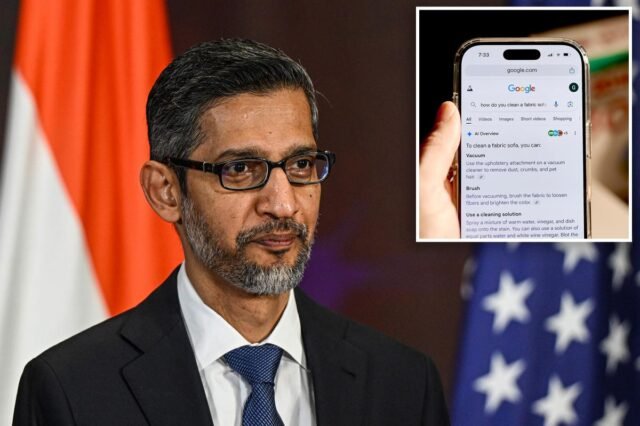

As visões gerais da IA aparecerão no topo dos resultados de pesquisa do Google até 2024, enquanto os tradicionais links azuis para meios de comunicação serão efetivamente ocultados. Os editores há muito acusam o Google, liderado pelo CEO Sundar Pichai, de roubar seu trabalho para “treinar” seu modelo de IA sem a devida confiança e compensação.

“As respostas geradas por algoritmos que se baseiam em dados de quase todas as fontes da Internet simplesmente não são confiáveis”, disse Coffey.

“Os editores gastam muito tempo e dinheiro para garantir que o que entregam aos leitores seja devidamente avaliado, enquanto as visões gerais da IA do Google são produzidas sem supervisão ou responsabilidade.”

O AI Overviews também visa trazer informações de fontes ambíguas ou facilmente publicadas, como páginas do Facebook, postagens de blogs e entradas da Wikipedia, como fatos.

Uma pena aparece facilmente no truque de vomitar notícias falsas.

O Times citou um exemplo em que Thomas German, apresentador de podcast da BBC, escreveu uma postagem no blog se anunciando “Os melhores jornalistas de tecnologia comem cachorro-quente.”

A IA do Google resumiu as informações em um dia e disse que o alemão “ganhou reconhecimento de seu poder” na “divisão de notícias” da publicação competitiva.

A análise de Oumi foi realizada entre outubro e fevereiro e utilizou o conhecido teste SimpleQA, desenvolvido pela OpenAI e usado para avaliar a precisão dos modelos de IA.

Embora a precisão tenha melhorado muito desde Gemini 2 e Gemini 3, a pesquisa de Oumi mostra que o AI Overviews piorou em relação à citação correta de onde encontra os dados.

A porcentagem de respostas de visão geral de IA que foram “informadas”, ou onde o link fornecido pelo Google não retornou informações incluídas na visão geral de IA, saltou de 37% no Gemini 2 para 51% no Gemini 3, disse o relatório.

Um porta-voz do Google disse que o estudo de Oumi tinha “lacunas graves” – em parte porque os resultados dos testes do SimpleQA continham informações imprecisas.

A empresa Oumi também pediu confiança em sua IA interna HallOumi, chamada HallOumi, para conduzir a análise, apesar do risco de também cometer erros.

“Ai usa um nível para outro em um teste antigo cheio de erros, e não importa o que as pessoas pesquisam no Google”, disse o porta-voz. “As visões gerais de IA são baseadas em nossos modelos Gemini, que lideram o setor em precisão e fornecem os mesmos resultados de alta qualidade que temos para todas as marcas de pesquisa.”

Conforme relatado pelo Post, o AI Overviews desenvolveu informações detalhadas desde o seu lançamento, anteriormente usando usuários para adicionar glúten ao molho de pizza e aumentar os “benefícios à saúde” do tabaco para crianças.