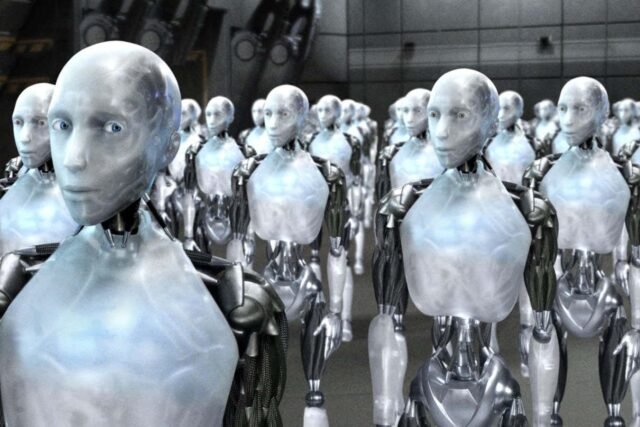

As três leis da robótica de Isaac Asimov não são um guia prático

Entretenimento/Imagens Alamy

Uma inteligência artificial superinteligente surgindo e destruindo a humanidade tem sido um tropo comum na ficção científica há décadas. Agora, vivemos num mundo onde a IA parece estar a desenvolver-se mais rapidamente do que nunca. Isso significa que você deve começar a se preocupar com o apocalipse da IA?

Em contraste com outros riscos existenciais, como as alterações climáticas, os riscos colocados pela IA são difíceis de quantificar. Estamos em território especulativo simplesmente porque compreendemos menos a situação do que os padrões climáticos.

O que sabemos com certeza é que muitas pessoas inteligentes estão preocupadas. Muitos chefes atuais de empresas de IA alertaram para a possibilidade de a IA causar a extinção humana, e até mesmo o pioneiro da inteligência artificial, Alan Turing, falou de um futuro onde os computadores se tornarão sencientes, antes de ultrapassarem as nossas capacidades e eventualmente assumirem o controlo.

O cenário é assim. Imagine que atribuímos a uma IA a única tarefa de resolver um problema grande e complexo como a hipótese de Riemann, um dos mais famosos problemas não resolvidos da matemática. Poderiam decidir que precisavam de um enorme poder computacional e, sem as restrições do bom senso, transformariam todos os objectos inanimados da Terra num supercomputador gigante, fazendo com que 8 mil milhões de pessoas morressem à fome em vastos e estéreis centros de dados. Talvez até nos use como matéria-prima também.

Agora, você poderia argumentar que, neste cenário, poderíamos prestar atenção ao que a IA está fazendo e dar uma dica rápida, dizendo: “A propósito, parece que você está transformando o mundo inteiro em um data center e, se for esse o caso, pare, porque ainda precisamos viver na Terra”. No entanto, algumas pessoas podem preferir ter salvaguardas para detectar problemas como este antes que ocorram e evitar qualquer dano.

O escritor de ficção científica Isaac Asimov resolveu este problema com as suas três leis da robótica, a primeira das quais é que um robô não deve ferir um ser humano ou, por inação, permitir que um ser humano seja ferido.

Então, em teoria, poderíamos dizer a uma IA para não nos machucar, e acontece que ela não nos machucará, certo? Sim Não. A nossa capacidade de incorporar salvaguardas e regras na IA é desajeitada e ineficaz. Podemos dizer aos grandes modelos de linguagem de hoje para não serem racistas, nem praguejarem, nem divulgarem receitas explosivas, mas, nas circunstâncias certas, eles farão essas coisas de qualquer maneira. Não entendemos o suficiente sobre o que está acontecendo dentro de um modelo de IA para impedi-lo de fazer coisas que não queremos.

Mesmo que tenhamos feito tudo isso, ainda há cenários em que o modelo de IA decide nos expulsar de propósito – Exterminador do Futuro ou Matriz cenário. Isto pode ocorrer após melhorias muito graduais na IA durante um longo período de tempo, ou quase imediatamente com uma singularidade – um processo hipotético em que uma IA se torna inteligente o suficiente para melhorar a si mesma, e depois itera rapidamente em alta velocidade, tornando-se cada vez mais inteligente, ultrapassando a inteligência humana num piscar de olhos.

E a IA pode decidir fazer isto porque tem medo que a matemos, ou porque não quer ser governada por nós, ou simplesmente porque pensa que a Terra estaria melhor sem a nossa interferência e confusão – um sentimento que muitas espécies de animais e plantas poderiam partilhar se fossem capazes de o fazer.

Isto pode ser feito através da utilização de laboratórios biológicos automatizados para criar vírus mortais, desencadeando um arsenal mundial de armas nucleares ou construindo um exército de robôs assassinos – ou simplesmente sequestrando robôs já construídos pelos governos. Talvez ele pudesse até fazer algo realmente maligno, astuto e astuto que ainda nem pensamos.

Na realidade, pode ser complicado. A IA pode querer erradicar os humanos, mas a sua influência é limitada. Sim, poderia deixar todos os semáforos verdes e causar acidentes de trânsito em alguns de nós. Isso pode causar uma queda de energia que pode ocorrer várias vezes. Isso pode causar a queda de alguns aviões. Mas exterminar 8 bilhões de pessoas de uma só vez? Não é uma tarefa fácil. E eles podem ter que se defender de outros modelos de IA que tentam impedir o sucesso de seus planos de assassinato.

Embora a maioria desses cenários pareça ficção científica impossível ou experimentos mentais implausíveis, os especialistas discordam sobre a probabilidade de eles acontecerem. E isso deveria nos dar uma pausa para pensar.

Hoje, empresas com enormes investimentos, vastos recursos e equipas compostas por algumas das pessoas mais inteligentes do mundo estão a competir para construir uma IA superinteligente. Quer você pense que isso acontecerá num futuro próximo ou não, e se isso terá um impacto negativo ou não, provavelmente podemos concordar que, se este for o caso de algumas pessoas, então é uma boa ideia desacelerar e pensar cuidadosamente antes de continuar. Infelizmente, o capitalismo não é um sistema capaz de considerar cuidadosamente as consequências antes de inovar, e os políticos de hoje parecem tão interessados nos potenciais benefícios económicos da IA que a regulamentação não é uma prioridade.

Então, qual a probabilidade de um desastre? UM artigo de 2024 Um inquérito realizado a cerca de 3.000 investigadores de IA publicados revelou que mais de metade estima a probabilidade de a IA causar a extinção humana ou o desamparo permanente e grave – a chamada p(desgraça) ou probabilidade de catástrofe – em pelo menos 10 por cento. Não sei você, mas prefiro que os números sejam bem menores.

Algumas pessoas que trabalham na área de IA estão otimistas quanto ao futuro e alguns especialistas argumentam que este será o fim da humanidade. É preocupante que façamos isso de qualquer maneira.

Pessoalmente, penso que não há nada de mágico no cérebro humano e na nossa consciência; é claro que não há nada que não possa ser imitado artificialmente. Assim, a longo prazo, muito provavelmente criaremos uma inteligência artificial que ultrapassará em muito as capacidades humanas. Mas penso que ainda estamos longe de compreender o que isso implica e muito menos de o conseguir.

Certamente não acredito que os modelos atuais estejam perto da ladeira escorregadia da singularidade – eles não conseguem nem contar até 100 de forma confiável – e eu não perderia tempo tentando descobrir tudo isso.

No entanto – e isto é um grande problema – isso não significa que a IA não traga grandes problemas.

Talvez o apocalipse da IA com o qual devêssemos nos preocupar seja, na verdade, a perda massiva de empregos causada pela automação, ou a perda gradual de habilidades humanas à medida que a IA assume mais tarefas, ou a crescente homogeneização da cultura, decorrente da arte, música e filmes gerados pela IA.

Ou talvez uma recessão global causada pela queda vertiginosa dos preços das acções de empresas tecnológicas que convenceram os investidores a entregar milhares de milhões de dólares com promessas extravagantes de máquinas superinteligentes cuja vida útil é muito mais longa do que o alegado. Esse cenário parece mais provável para mim e mais próximo.

Tópico: