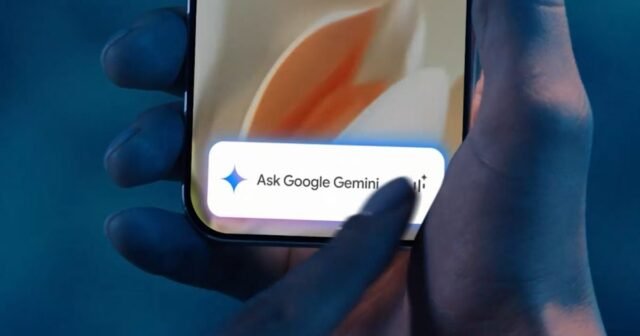

O Google realmente mostrou como o Android 17 pode mudar a forma como usamos nossos telefones. Novas ferramentas para desenvolvedores Anúncio de terça-feira Você pode acessar aplicativos diretamente com agentes de IA como Gemini para encontrar fotos, gerenciar calendários e agendar viagens compartilhadas com várias paradas enquanto você faz outras coisas.

A ideia é simples. Em vez de abrir os aplicativos um por um, você diz à IA o que precisa. O Google chama isso de ‘Agentic Future’ e será lançado na série Galaxy S26 e em dispositivos Pixel 10 selecionados a partir de agora. Você pode entregar tarefas complexas ao Gemini pressionando e segurando o botão liga / desliga do telefone. A IA funciona em aplicativos de entrega de comida, mercearia e carona nos EUA e na Coreia.

Duas maneiras pelas quais Gêmeos assume o controle

O Google está construindo isso em duas vertentes. O primeiro é o AppFunctions, uma estrutura que permite aos desenvolvedores expor funcionalidades específicas do aplicativo diretamente à IA. A integração da Galeria Samsung no Galaxy S26 mostra como funciona Você perguntou ao Gemini: “Mostre-me uma foto do meu gato na Galeria Samsung”. A IA o encontra e exibe. Nunca abra o aplicativo Galeria. Já está disponível para calendários, notas e tarefas em dispositivos de diversos fabricantes.

A segunda faixa é mais larga. Para aplicativos sem integrações dedicadas, o Google está testando uma estrutura de UI Automation. Isso permite que o Gemini execute tarefas comuns. A versão beta será lançada no mesmo dispositivo, suportando um conjunto selecionado de aplicativos nas categorias de entrega de comida, mercearia e compartilhamento de carona. A IA usa o contexto do aplicativo existente para lidar com tarefas de várias etapas.

Você ainda está sentado no banco do motorista.

Deixar a IA dentro de um aplicativo parece um risco à privacidade. O Google afirma que projetou esses recursos tendo em mente a privacidade e a segurança. À medida que o Gemini executa tarefas por meio da automação da IU, você pode ver o progresso por meio de notificações ou visualizações em tempo real. Se algo parece errado, eu entro e assumo manualmente.

Protetores adicionais se aplicam a operações sensíveis. Gemini enviará notificações antes de você concluir uma ação, como uma compra. O trabalho real acontece no seu dispositivo, não em um servidor remoto. O Google organiza isso com controles do usuário refletidos na experiência. O objetivo é fazer com que a automação pareça útil, em vez de assustadora.

Android 17 e o que está por vir

Ainda é muito cedo. O Google está começando com um pequeno número de desenvolvedores para potencializar a experiência. A visualização do UI Automation é limitada a dispositivos e categorias de aplicativos específicos em apenas dois países. No entanto, o roteiro aponta para o Android 17, o momento em que esses recursos serão expandidos para mais usuários, desenvolvedores e fabricantes de dispositivos.

Se você possui atualmente um Galaxy S26 ou algum Pixel 10s, pode experimentar a versão beta quando ela for lançada. Para todos os outros, a entrega é simples. Seu telefone ficará mais inteligente para lidar com tarefas tediosas. Há uma mudança entre abrir um aplicativo e dizer à IA o que você precisa. O Android 17 começará a parecer normal ainda este ano.